バックナンバーはこちら。

https://www.simulationroom999.com/blog/compare-matlabpythonscilabjulia4-backnumber/

はじめに

勾配降下法をプログラム的に確認する。

今回はPython。

登場人物

博識フクロウのフクさん

イラストACにて公開の「kino_k」さんのイラストを使用しています。

https://www.ac-illust.com/main/profile.php?id=iKciwKA9&area=1

エンジニア歴8年の太郎くん

イラストACにて公開の「しのみ」さんのイラストを使用しています。

https://www.ac-illust.com/main/profile.php?id=uCKphAW2&area=1

【再掲】勾配降下法の確認プログラムのフロー

太郎くん

とりあえず、勾配降下法の確認プログラムのフローを再掲

- 目的関数の定義

- 目的関数の導関数の定義

- 入力初期値設定

- ハイパーパラメータの設定

- 勾配降下法の実装

- 結果表示

- グラフへのプロット

フクさん

これをPythonで実施する。

Pythonコード

フクさん

Pythonコードは以下。

import numpy as np

import matplotlib.pyplot as plt

# 目的関数の定義(例: f(x) = sin(5x) + 0.5x^2)

def f(x):

return np.sin(5*x) + 0.5*x**2

# 目的関数の微分(例: df(x)/dx = 5cos(5x) + x)

def df(x):

return 5*np.cos(5*x) + x

# 初期値の設定

x = 2.9 # 初期値

# ハイパーパラメータの設定

learning_rate = 0.1 # 学習率

max_iterations = 100 # 最大イテレーション数

# 学習過程を保存するための変数

x_history = np.zeros(max_iterations)

f_history = np.zeros(max_iterations)

# 勾配降下法の実装

for i in range(max_iterations):

# 勾配の計算

gradient = df(x)

# パラメータの更新

x = x - learning_rate * gradient

# 学習過程の保存

x_history[i] = x

f_history[i] = f(x)

# 結果の表示

print('optimal solution:')

print(x)

print('optimal value:')

print(f(x))

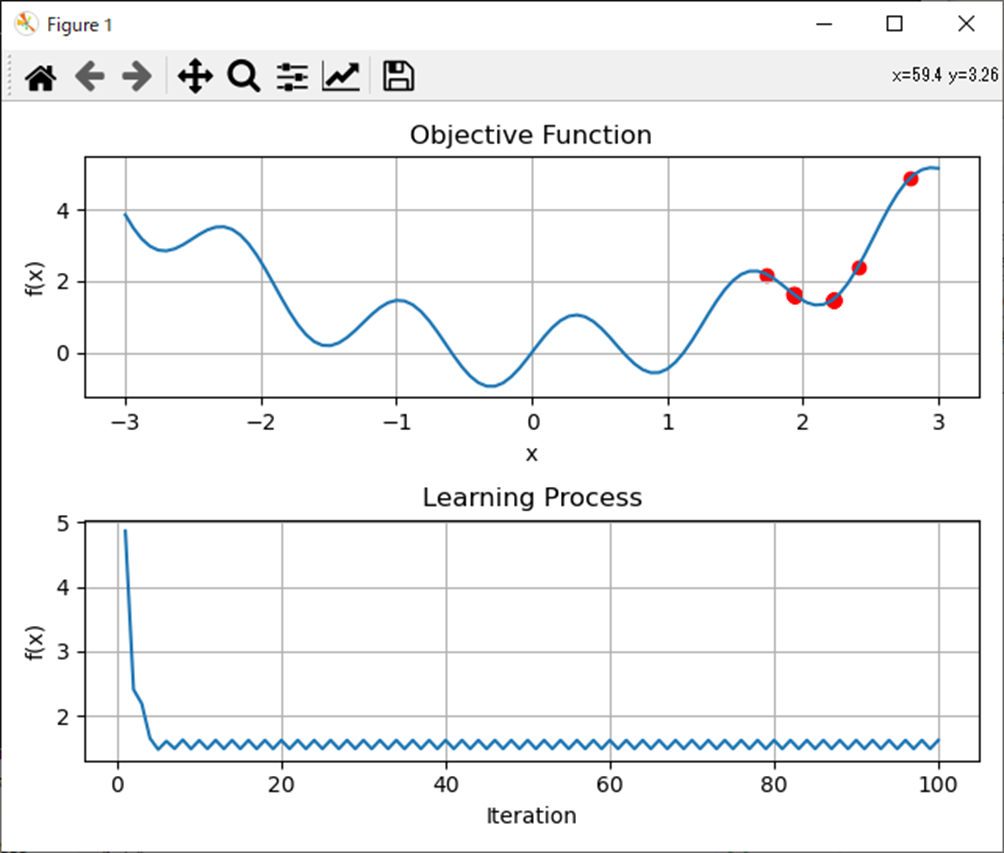

# グラフのプロット

fig, axes = plt.subplots(2, 1)

# Objective Functionのプロット

x_vals = np.linspace(-3, 3, 100)

f_vals = f(x_vals)

axes[0].plot(x_vals, f_vals)

axes[0].scatter(x_history, f_history, color='r')

axes[0].set_xlabel('x')

axes[0].set_ylabel('f(x)')

axes[0].set_title('Objective Function')

axes[0].grid()

# Learning Processのプロット

iterations = np.arange(1, max_iterations + 1)

axes[1].plot(iterations, f_history)

axes[1].set_xlabel('Iteration')

axes[1].set_ylabel('f(x)')

axes[1].set_title('Learning Process')

axes[1].grid()

plt.tight_layout()

plt.show()処理結果

フクさん

処理結果は以下。

optimal solution:

1.936047911053309

optimal value:

1.6214487071489236考察

太郎くん

まぁ、MATLABと同じ結果だね。

局所最適解に陥ってる。

フクさん

回避方法も最適化アルゴリズムによる学習率の動的な変更だな。

まとめ

フクさん

まとめだよ。

- 勾配降下法の実験をPythonで実施。

- 予想通り局所最適解に陥った。

- 局所最適解の回避方法としては学習率を状況に応じて変更する様々は最適化アルゴリズムがある。

- モーメンタム、AdaGrad、Adamなどなど。

バックナンバーはこちら。

Pythonで動かして学ぶ!あたらしい線形代数の教科書

Amazon.co.jp: Pythonで動かして学ぶ!あたらしい線形代数の教科書 eBook : かくあき: Kindleストア

Amazon.co.jp: Pythonで動かして学ぶ!あたらしい線形代数の教科書 eBook : かくあき: Kindleストア

ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装

ゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装 | 斎藤康毅 |本 | 通販 | Amazon

Amazonで斎藤康毅のゼロから作るDeep Learning ―Pythonで学ぶディープラーニングの理論と実装。アマゾンならポイント還元本が多数。斎藤康毅作品ほか、お急ぎ便対象商品は当日お届けも可能。またゼロから作るDeep Learn...

ゼロからはじめるPID制御

ゼロからはじめるPID制御 | 熊谷 英樹 |本 | 通販 | Amazon

Amazonで熊谷 英樹のゼロからはじめるPID制御。アマゾンならポイント還元本が多数。熊谷 英樹作品ほか、お急ぎ便対象商品は当日お届けも可能。またゼロからはじめるPID制御もアマゾン配送商品なら通常配送無料。

OpenCVによる画像処理入門

OpenCVによる画像処理入門 改訂第3版 (KS情報科学専門書) | 小枝 正直, 上田 悦子, 中村 恭之 |本 | 通販 | Amazon

Amazonで小枝 正直, 上田 悦子, 中村 恭之のOpenCVによる画像処理入門 改訂第3版 (KS情報科学専門書)。アマゾンならポイント還元本が多数。小枝 正直, 上田 悦子, 中村 恭之作品ほか、お急ぎ便対象商品は当日お届けも可能。...

恋する統計学[回帰分析入門(多変量解析1)] 恋する統計学[記述統計入門]

恋する統計学[回帰分析入門(多変量解析1)] 恋する統計学[記述統計入門] | 金城俊哉 | 数学 | Kindleストア | Amazon

Amazonで金城俊哉の恋する統計学 恋する統計学。アマゾンならポイント還元本が多数。一度購入いただいた電子書籍は、KindleおよびFire端末、スマートフォンやタブレットなど、様々な端末でもお楽しみいただけます。

Pythonによる制御工学入門

Amazon.co.jp: Pythonによる制御工学入門 (改訂2版) eBook : 南裕樹: Kindleストア

Amazon.co.jp: Pythonによる制御工学入門 (改訂2版) eBook : 南裕樹: Kindleストア

理工系のための数学入門 ―微分方程式・ラプラス変換・フーリエ解析

理工系のための数学入門 ―微分方程式・ラプラス変換・フーリエ解析― | 一色秀夫, 塩川高雄 | 数学 | Kindleストア | Amazon

Amazonで一色秀夫, 塩川高雄の理工系のための数学入門 ―微分方程式・ラプラス変換・フーリエ解析―。アマゾンならポイント還元本が多数。一度購入いただいた電子書籍は、KindleおよびFire端末、スマートフォンやタブレットなど、様々な端...

コメント